1-bit LLMを理解する | 論文メモ: The Era of 1-bit LLMs: All Large Language Models are in 1.58 Bits - BioErrorLog Tech Blog

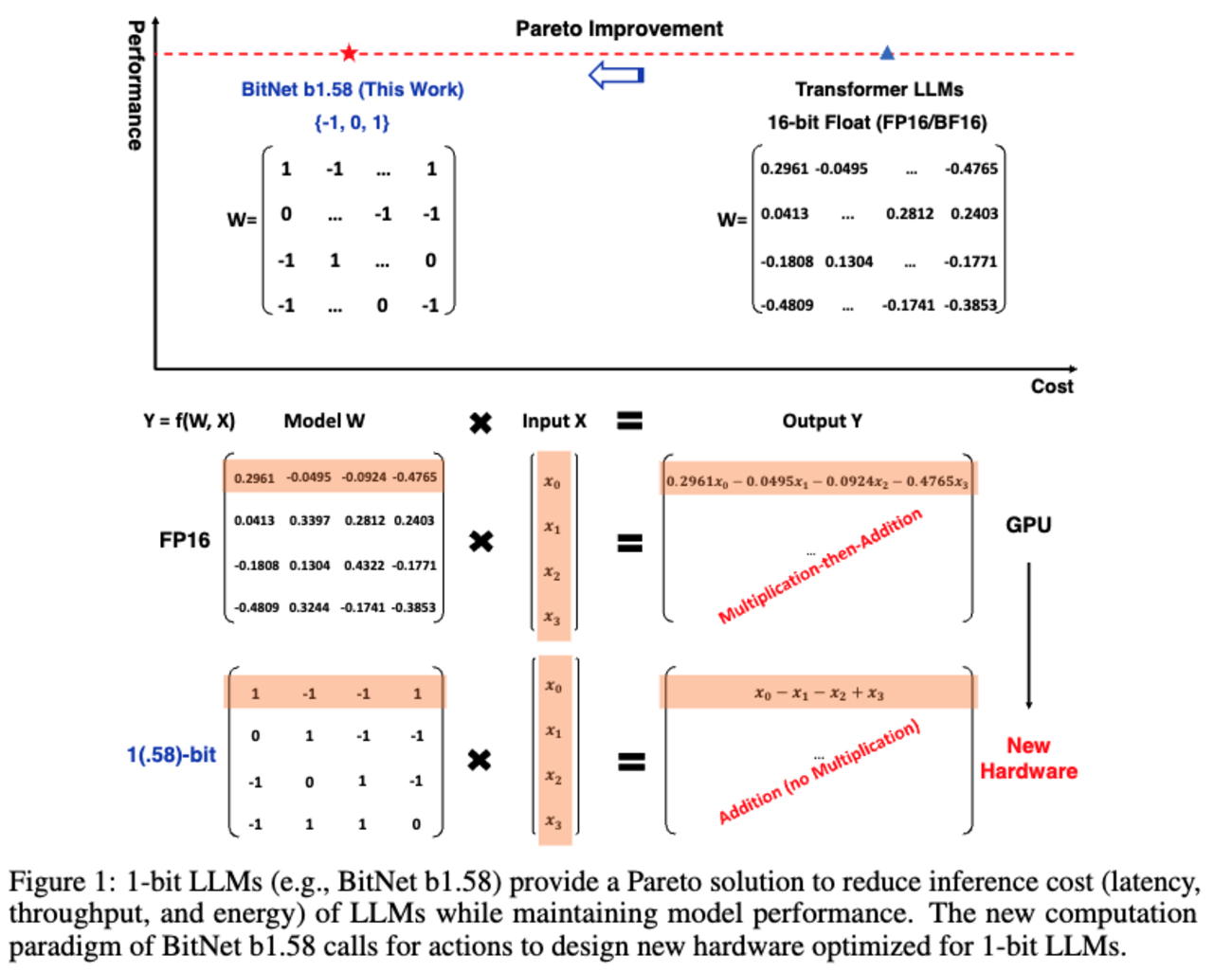

"The Era of 1-bit LLMs: All Large Language Models are in 1.58 Bits" の論文要約メモです。 はじめに The Era of 1-bit LLMs: All Large Language Models are in 1.58 Bits 概要 手法 結果 おわりに/所感 参考 はじめに 今回まとめる論文はこちら: arxiv.org 2024/02/27 公開 Microsoftのチーム コード: unilm/bitnet at master · microsoft/unilm · GitHub なお本記事で掲載する図は全て上記論文…| BioErrorLog Tech Blog